Te-ai întrebat vreodată dacă traficul pe care îl vezi în rapoarte este 100% real? Sincer, e o întrebare pe care ar trebui să și-o pună oricine lucrează în digital. Realitatea din teren ne arată că, de multe ori, cifrele pot minți, iar o analiză superficială bazată doar pe ce vezi în Analytics te poate duce pe un drum complet greșit.

De ce cifrele din analytics pot fi înșelătoare

Să te încrezi orbește în datele de trafic, fără să le treci printr-un filtru critic, e una dintre cele mai mari capcane în care poți cădea. Cifre umflate de boți, erori de tracking care îți scapă sau trafic total irelevant îți pot deforma complet percepția asupra performanței reale a site-ului.

Nu e de ajuns să deschizi Google Analytics și să copiezi niște numere într-un raport. Trebuie să ai o metodă solidă de validare. Altfel, riști să arunci bugete considerabile pe canale de marketing care, de fapt, nu aduc clienți reali, ci doar vizite-fantomă.

Principalele surse de date incorecte

Traficul pe care îl analizezi poate fi “murdărit” din mai multe motive. Primul pas spre o strategie eficientă este să știi exact de unde vin aceste probleme.

- Traficul de la boți și crawlere: O bună parte din traficul de pe internet nu provine de la oameni. Vorbim despre boți de spam, crawlere agresive sau tot felul de scripturi automatizate care îți umflă artificial numărul de vizite, sesiuni și afișări de pagină.

- Erori de implementare a tracking-ului: Un cod de tracking implementat de două ori pe aceeași pagină, configurat prost sau pur și simplu uitat de la o versiune veche a site-ului poate duce la dublarea datelor sau la colectarea lor complet eronată.

- Trafic intern și de la parteneri: Vizitele de la propria echipă, de la agenția cu care lucrezi sau de la diverși colaboratori vor murdări datele dacă nu sunt filtrate corect. Acestea nu reflectă comportamentul clienților tăi.

- Referral spam: Ai văzut vreodată în rapoarte surse de trafic de la site-uri dubioase, de care n-ai auzit niciodată? Acesta este referral spam – linkuri fantomă care apar în rapoarte, dar care n-au adus niciodată un vizitator real.

Impactul datelor eronate asupra deciziilor

Când strategia ta se bazează pe cifre greșite, e ca și cum ai construi o casă pe o fundație instabilă. Inevitabil, ceva va merge prost. Deciziile luate pe baza unor date “murdare” au consecințe costisitoare.

O analiză superficială duce la concluzii deformate despre cine sunt clienții tăi reali. Abordarea completă, care combină mai multe unelte pentru a face o verificare trafic site riguroasă, este singura cale pentru a obține o imagine clară a performanței tale online.

Gândește-te că monitorizarea traficului în România are o tradiție de peste 20 de ani, fiind susținută de platforme care ajută exact la validarea audienței. Acestea oferă statistici pentru milioane de site-uri, ajutându-ne pe noi, marketerii, să vedem performanța reală. De exemplu, datele BRAT indică un trafic lunar de peste 376.000 de vizitatori pentru profit.ro sau 458.000 de vizitatori pentru pieseauto.ro. Aceste instrumente sunt esențiale pentru a separa traficul autentic de zgomot. Poți afla mai multe despre cum se face monitorizarea audienței online pe trafic.ro.

În final, o perspectivă corectă și validată te ajută să înțelegi ce funcționează cu adevărat și unde merită să-ți concentrezi eforturile și, mai ales, bugetul.

Fundația: Cum să pui bazele unui tracking corect în GA4

Oricât de avansate ar fi metodele de verificare a traficului, totul e în zadar dacă datele de la care pleci sunt greșite. Google Analytics 4 (GA4) este, pentru majoritatea dintre noi, punctul zero al oricărei analize. O configurare făcută ca la carte este fundația pe care vei clădi orice decizie de business.

Dacă fundația e șubredă, te vei lupta mereu cu cifre care nu se leagă și vei pierde timp prețios reparând probleme care puteau fi evitate din start.

Implementarea codului de tracking – fără greșeli

Primul și cel mai des întâlnit obstacol este implementarea defectuoasă a codului de tracking. Văd constant aceeași greșeală, mai ales după un redesign sau o migrare de site: dubla contorizare. Se întâmplă când codul GA4 ajunge să fie injectat de două ori – o dată direct în codul site-ului și încă o dată prin Google Tag Manager, de exemplu. Sau când mai multe pluginuri fac același lucru simultan.

Care e efectul? O rată de respingere (bounce rate) care tinde spre 0%, complet nerealistă, și un număr de afișări de pagină umflat artificial. Practic, fiecare vizitator real e numărat de două ori, ceea ce îți dă o imagine total deformată a interacțiunii pe site.

Ca să verifici rapid, instalează extensia de browser Google Tag Assistant. Plimbă-te pe site-ul tău și uită-te dacă pe fiecare pagină apare un singur tag GA4. Dacă vezi mai multe, e timpul să investighezi și să elimini codurile în plus.

Activarea Google Signals pentru o imagine de ansamblu

Google Signals este o funcție extrem de utilă în GA4. Colectează date agregate și anonimizate de la utilizatorii care și-au dat acordul pentru personalizarea reclamelor în contul lor Google. Activând-o, capeți acces la rapoarte cross-device și la date demografice și de interese mult mai detaliate.

Concret, te ajută să înțelegi cum un client descoperă produsul pe mobil în pauza de masă, dar finalizează comanda seara, de pe laptop. Fără Google Signals, aceste două interacțiuni ar părea că vin de la doi utilizatori diferiți, nu de la unul singur.

Atenție, însă: activarea Google Signals impune o actualizare a politicii de confidențialitate. E obligatoriu să-ți informezi vizitatorii că folosești funcționalități de publicitate Google și că datele lor sunt parte din acest proces.

Filtrarea traficului care nu contează

Datele curate sunt cele relevante. Vizitele generate de propria echipă, de agenția SEO sau de programatori nu reflectă comportamentul clienților tăi reali. Dimpotrivă, „murdăresc” rapoartele și strică indicatori importanți, cum ar fi rata de conversie sau timpul mediu petrecut pe pagină.

Din fericire, GA4 are o soluție simplă pentru a exclude traficul intern.

- Definește traficul intern: Mergi în Admin > Data Streams, selectează fluxul tău de date, apoi Configure tag settings > Show more > Define internal traffic. Aici poți crea reguli pe baza adreselor IP. Adaugă IP-urile de la birou sau rețelele folosite de echipa ta.

- Activează filtrul: Apoi, navighează la Admin > Data Settings > Data Filters. Acolo vei găsi un filtru numit “Internal Traffic”. Doar asigură-te că este în starea “Active”.

Odată ce ai făcut asta, vizitele de la IP-urile specificate vor fi ignorate, lăsându-ți o imagine clară a comportamentului vizitatorilor reali. Pe platforme mai complexe, o bună optimizare a site-ului WordPress poate implica și pluginuri care te ajută să gestionezi aceste excluderi și mai precis.

Blocarea automată a traficului de boți

O altă sursă de poluare a datelor o reprezintă boții și spiderii. Acești roboți scanează internetul încontinuu, dar nu au nicio legătură cu utilizatorii umani pe care vrei să-i analizezi.

Vestea bună e că GA4 are o funcție nativă pentru asta.

- Verifică setarea: Mergi la Admin > Data Streams > [Selectează stream-ul tău]. Implicit, GA4 are o opțiune activată care filtrează traficul cunoscut de la boți. Aceasta se bazează pe o listă menținută de Google și de IAB (Interactive Advertising Bureau).

Chiar dacă nu va prinde 100% din traficul fals, această setare este o primă linie de apărare esențială și extrem de eficientă, care te scapă de mult zgomot din rapoarte.

Ce-ți spun, de fapt, log-urile de server despre trafic

Dacă Google Analytics e fațada casei, log-urile de server sunt planurile fundației. Analytics îți arată ce se întâmplă în browserul vizitatorului, dar povestea completă, cea brută și nefiltrată, o găsești doar în jurnalul de bord al site-ului tău: log-urile de server.

Gândește-te la ele ca la un registru care notează absolut fiecare cerere trimisă către server. Nu contează dacă e un client real, un crawler de la Google sau un bot dubios. Serverul notează totul. Tocmai de aceea, analiza lor îți oferă o perspectivă esențială pentru o verificare trafic site făcută ca la carte.

Ce sunt și unde găsești aceste log-uri?

În esență, log-urile sunt niște fișiere text, simple, pe care serverul le generează automat și le stochează direct pe mașina unde e găzduit site-ul tău. Sunt înregistrările paznicului care notează cine intră, la ce oră și ce anume caută.

Majoritatea furnizorilor de hosting îți oferă acces direct la ele din panoul de control (de obicei, cPanel). Caută secțiuni cu nume precum “Raw Access Logs” sau “Logs”. Dacă ești mai tehnic, poți accesa log-urile direct prin SSH, o metodă mult mai flexibilă, preferată de developeri.

Ce comori ascund aceste fișiere?

- Adrese IP: Vezi de unde vin cererile, un detaliu perfect pentru a depista activitate suspectă de la o singură sursă.

- Timestamp: Data și ora exactă pentru fiecare request. Așa poți corela un vârf de trafic cu o campanie sau un eveniment.

- User-Agents: Afli ce browser sau ce robot a făcut cererea (ex. Googlebot, SemrushBot sau un script necunoscut).

- Coduri de status HTTP: Vezi dacă o pagină a fost livrată corect (cod 200), nu a fost găsită (404) sau a apărut o eroare de server (500).

Cum interpretezi datele fără să te sperii de ele

Să deschizi un fișier log brut e ca și cum ai încerca să citești Matrix. Mii de linii de text. Din fericire, nu trebuie să faci asta manual. Majoritatea pachetelor de găzduire includ unelte care transformă datele astea în rapoarte vizuale, prietenoase.

Cele mai cunoscute sunt AWStats și Webalizer. Le găsești de obicei în cPanel și, cu un singur click, îți generează grafice despre vizitatori, pagini accesate, erori și multe altele. Aici începi să vezi lucrurile pe care Analytics le ascunde.

De exemplu, s-ar putea să observi un anume bot (un user-agent specific) care face mii de cereri pe zi, îți mănâncă resursele și încetinește site-ul pentru vizitatorii reali. GA4 nu ți-ar arăta asta niciodată. Analiza aceasta e crucială, indiferent de tipul de găzduire. Ca să înțelegi mai bine ce ți se potrivește, poți arunca un ochi pe un ghid despre ce sunt serverele și cum să-l alegi pe cel potrivit.

Confruntarea datelor: log-uri vs. GA4

Acum vine partea interesantă: punem datele din log-uri lângă cele din GA4. Când vezi diferențe mari, e un semnal de alarmă care merită investigat.

Înainte de a compara, e vital să înțelegem ce măsoară fiecare.

Comparație între sursele de date pentru trafic

Acest tabel evidențiază diferențele fundamentale între datele colectate prin Google Analytics și cele din log-urile de server, ajutând la înțelegerea punctelor forte și a limitărilor fiecărei metode.

| Criteriu de comparație | Google Analytics (GA4) | Log-uri de server |

|---|---|---|

| Ce măsoară? | Interacțiunile utilizatorilor în browser (evenimente, sesiuni). | Toate cererile (hits) făcute către server. |

| Cine e măsurat? | Vizitatorii care au JavaScript activat și nu folosesc ad-blockere. | Absolut tot: oameni, boți, crawlere, scripturi. |

| Cum colectează? | Prin cod JavaScript (tag) executat în browserul clientului. | Înregistrare directă, la nivel de server, a fiecărei cereri. |

| Acuratețe | Afectată de ad-blockere, setări de confidențialitate, erori JS. | 100% acuratețe a cererilor primite de server. |

| Tip de date | Date despre audiență și comportament (demografie, conversii). | Date brute, tehnice (IP, user-agent, status HTTP). |

Pe scurt, log-urile îți oferă o imagine completă a activității serverului, în timp ce GA4 îți oferă o imagine rafinată a comportamentului utilizatorilor.

Log-urile de server îți arată ce se întâmplă cu serverul tău, în timp ce Google Analytics îți arată ce fac utilizatorii în browser. Acestea sunt două perspective complementare, nu concurente. A le folosi împreună este cheia pentru o imagine completă a traficului.

Să luăm un scenariu concret: log-urile arată 20.000 de “hits” (cereri) într-o zi, dar GA4 raportează doar 2.000 de sesiuni. Ce se întâmplă?

Posibile explicații:

- Un volum uriaș de trafic non-uman: Majoritatea cererilor vin de la boți și crawlere pe care GA4 (în mod corect) le filtrează sau care pur și simplu nu execută JavaScript.

- Probleme de tracking: Poate codul tău Analytics nu e implementat corect pe toate paginile sau este blocat de anumite browsere sau extensii.

- Atacuri de tip DDoS la scară mică: Un număr mare de cereri automate menite să-ți consume resursele serverului.

Prin această comparație, log-urile devin un instrument de diagnosticare extrem de puternic. Ele validează datele din Analytics și scot la lumină tot felul de activități “invizibile” care îți pot afecta performanța și securitatea. A le ignora înseamnă să navighezi pe jumătate legat la ochi.

Validarea datelor cu Google Search Console și Cloudflare

Când vine vorba de verificarea traficului unui site, una dintre cele mai mari greșeli pe care le poți face este să te bazezi pe o singură sursă de date. Google Analytics este o unealtă excelentă, fără îndoială, dar nu este perfectă. Și, cel mai important, nu vede tot ce se întâmplă. Adevărata încredere în cifrele tale vine din validarea încrucișată – adică, din compararea informațiilor din mai multe sisteme independente. Doar așa poți fi sigur că tendințele pe care le vezi sunt reale.

Aici intră în scenă două instrumente cheie: Google Search Console (GSC) și serviciile CDN, cum ar fi Cloudflare. Fiecare îți oferă o perspectivă unică asupra traficului, iar împreună îți conturează o imagine mult mai completă și mai apropiată de realitate.

Să le luăm pe rând și să vedem cum le folosim concret.

Cum corelezi datele din GSC cu cele din GA4

La prima vedere, pare simplu. GSC îți arată click-urile din căutările organice pe Google, iar GA4 îți arată sesiunile venite din organic. Te-ai aștepta ca aceste cifre să fie, dacă nu identice, măcar foarte apropiate. În realitate, lucrurile stau destul de diferit.

Să fim clari: cifrele nu vor fi niciodată 1 la 1. Și este perfect normal să fie așa.

Există câteva motive solide pentru aceste discrepanțe:

- Definiții diferite: Un „click” în GSC este exact asta – cineva a dat click pe linkul tău în pagina de rezultate Google. O „sesiune” în GA4 se înregistrează doar după ce codul de tracking de pe site-ul tău se încarcă complet în browserul vizitatorului. Dacă cineva dă click, dar închide tab-ul înainte ca scriptul GA4 să apuce să ruleze, vei avea un click în GSC, dar nicio sesiune în Analytics.

- Blocarea tracking-ului: Tot mai mulți oameni folosesc ad-blockere sau browsere cu setări de confidențialitate stricte. Acestea pot bloca complet scriptul GA4. GSC va număra click-ul, dar pentru GA4, vizitatorul respectiv pur și simplu nu există.

- Probleme tehnice: Erorile de JavaScript sau un site care se încarcă foarte, foarte greu pot împiedica și ele executarea codului GA4.

Aici, cheia nu este să încerci să faci numerele să se potrivească perfect. Este imposibil. Important este ca tendințele să fie similare. Dacă GSC îți arată o creștere de 30% la click-urile organice într-o lună, te aștepți să vezi o creștere asemănătoare și în sesiunile organice din GA4. Poate nu va fi tot de 30%, dar trendul ar trebui să fie clar ascendent. Dacă GSC arată o creștere, iar GA4 o scădere, atunci ai un semnal de alarmă serios că ceva este în neregulă cu tracking-ul tău.

Ce îți arată Cloudflare și de ce este esențial

Acum, hai să trecem la un nivel și mai profund. Dacă GSC și GA4 îți oferă o perspectivă dinspre motorul de căutare și, respectiv, din browserul utilizatorului, Cloudflare îți oferă o imagine de la „poarta de intrare” a serverului tău. Pentru că funcționează la nivel de DNS, Cloudflare vede absolut fiecare cerere (request) făcută către domeniul tău, înainte ca aceasta să ajungă la serverul de găzduire.

Informațiile din panoul de control Cloudflare sunt o adevărată mină de aur pentru oricine vrea să înțeleagă ce se întâmplă cu adevărat.

- Totalul cererilor: Aici vezi scara reală a activității. GA4 îți poate arăta 1.000 de sesiuni pe zi, dar Cloudflare îți poate arăta 200.000 de cereri. Diferența asta colosală vine de la boți, crawlere de tot felul, scripturi automate și alte zeci de tipuri de accesări pe care Analytics le filtrează sau pur și simplu nu le vede.

- Traficul malițios blocat: Probabil una dintre cele mai valoroase secțiuni. Cloudflare îți arată, în timp real, câte amenințări a oprit înainte să-ți afecteze site-ul: atacuri DDoS, tentative de SQL injection, spammeri și multe altele. Acesta este un trafic pe care nu doar că nu-l vei vedea niciodată în GA4, dar care, fără un CDN, ți-ar consuma inutil resursele serverului și ar încetini experiența pentru vizitatorii reali.

Comparând aceste date cu Analytics și log-urile de pe server, începi să înțelegi cât de mult „zgomot” există în jurul site-ului tău. Pentru mai multe informații, poți citi despre Cloudflare ca soluție de top pentru găzduirea site-urilor.

Această abordare de validare în trei puncte (GA4, GSC, Cloudflare) te ajută să treci de la o simplă citire de rapoarte la o înțelegere profundă a întregului ecosistem digital. Îți permite să separi traficul uman, valoros, de zgomotul de fond al internetului și să iei decizii bazate pe o imagine completă, nu doar pe o mică parte din ea.

Cum depistezi și filtrezi traficul fals

Acum că am pus la punct instrumentele și am comparat cifrele, e timpul să intrăm în rolul de detectiv. Chiar dacă ai filtrele de bază activate, o parte din traficul non-uman sau de calitate îndoielnică tot va reuși să se strecoare în rapoartele tale din Google Analytics 4. O verificare a traficului site-ului înseamnă, în acest punct, să cauți tipare anormale care trădează prezența vizitatorilor nedoriți.

Misiunea ta este simplă, dar crucială: să identifici și să izolezi acest “zgomot de fond” pentru a avea o imagine curată a ce fac utilizatorii reali. Doar așa poți lua decizii de business bazate pe date solide, nu pe cifre umflate.

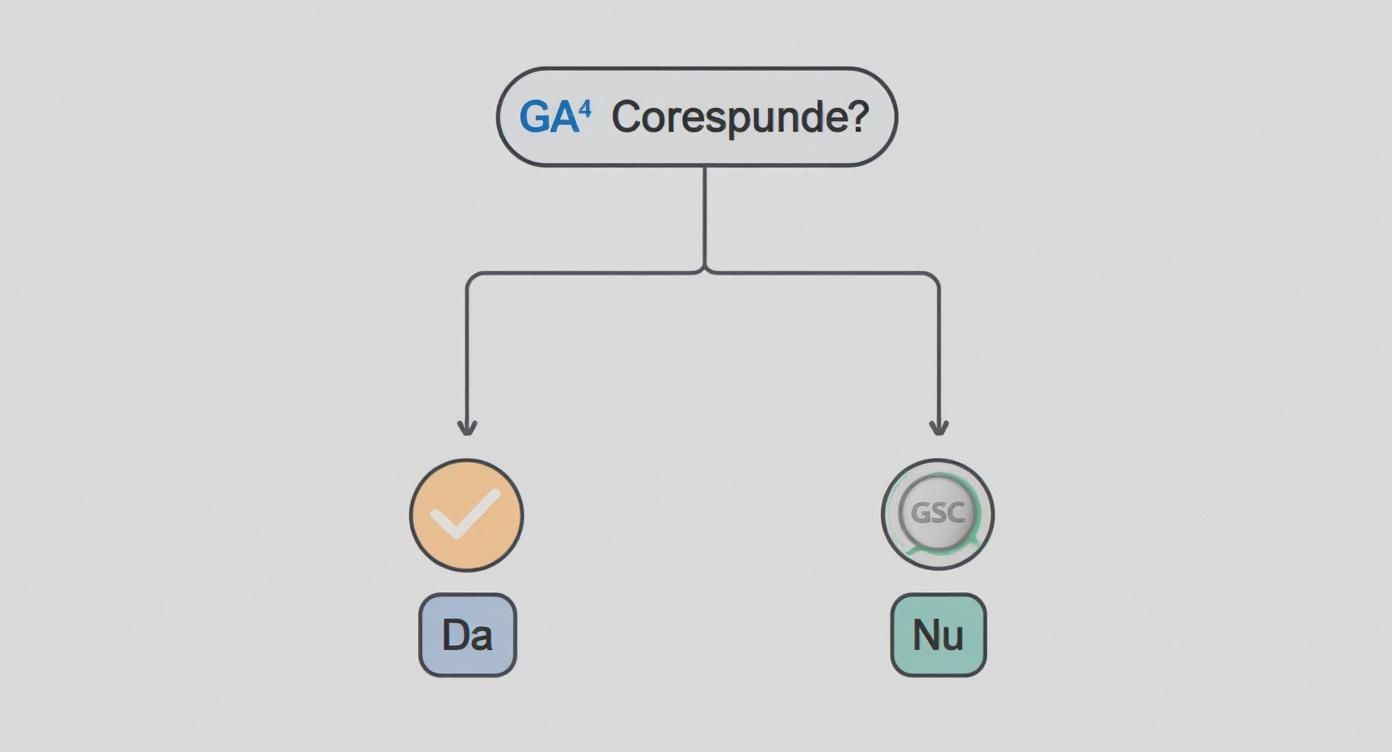

Ca să nu te pierzi în detalii, poți urma o logică simplă pentru a vedea dacă datele tale sunt curate sau dacă trebuie să sapi mai adânc.

This decision tree outlines a basic validation workflow. You start by analyzing your GA4 data, and if something doesn’t add up, you cross-reference it with Google Search Console (GSC) to understand the discrepancies.

Semnale de alarmă: ce trădează traficul fals în GA4

Boții, mai ales cei simpli, lasă în urmă amprente digitale evidente. Nu se comportă ca un om. Când te uiți prin rapoartele din GA4, anumite semnale de alarmă ies imediat în evidență și arată clar prezența traficului automatizat.

Iată la ce trebuie să fii atent pentru a găsi rapid segmentele de trafic suspecte.

- Sesiuni de 0 secunde: Un om are nevoie de măcar câteva secunde să proceseze pagina. Un număr mare de sesiuni care durează fix 0 secunde este un indiciu clasic de trafic robotic.

- Rate de respingere de 100%: Chiar dacă metrica “bounce rate” nu mai e standard în GA4 (dar o poți adăuga), o rată de respingere de 100% de la o anumită sursă înseamnă că fiecare vizitator a plecat fără să facă nimic. Un comportament tipic pentru boți.

- Locații geografice ciudate: Dacă vinzi flori doar în București, dar vezi un val brusc de trafic din India, fără vreo campanie care să explice asta, e aproape sigur trafic fals.

- Furnizori de internet (ISP) neobișnuiți: Verifică raportul de ISP-uri. Traficul care vine de la furnizori cunoscuți de hosting sau centre de date (ca Amazon Web Services, Google Cloud, OVH) este, în 99% din cazuri, non-uman. Utilizatorii reali vin de pe rețele rezidențiale, precum Digi sau Vodafone.

Acestea sunt cele mai comune semnale de alarmă pe care le poți observa în Google Analytics. Tabelul de mai jos sumarizează acești indicatori și acțiunile pe care le poți lua.

| Indicator (Metric) | Comportament suspect | Acțiune recomandată |

|---|---|---|

| Durata medie a sesiunii | Un număr mare de sesiuni cu durata de 0-1 secunde. | Filtrează traficul după locație sau ISP pentru a izola sursa. |

| Rata de respingere (Bounce Rate) | Rata de respingere de 100% de la o anumită sursă de trafic. | Creează un segment pentru a analiza acea sursă în detaliu. |

| Locație geografică | Vârfuri de trafic din țări sau orașe irelevante pentru afacerea ta. | Exclude traficul de la IP-urile sau regiunile geografice suspecte. |

| Furnizor de servicii (ISP) | Trafic masiv de la ISP-uri asociate cu centre de date (ex. Amazon, Google). | Adaugă filtre pentru a exclude traficul de la acești furnizori de hosting. |

Monitorizând constant acești indicatori, poți reacționa rapid și poți menține datele curate, asigurându-te că rapoartele tale reflectă comportamentul clienților reali.

Cum creezi segmente și filtre avansate în GA4

Odată ce ai identificat tiparele suspecte, treci la acțiune. Google Analytics 4 îți dă uneltele necesare să construiești segmente avansate pentru a analiza datele din trecut și filtre de excludere pentru a bloca traficul fals pe viitor.

Să zicem că ai descoperit un val de trafic din orașul Ashburn, Virginia (o locație cunoscută pentru centrele de date AWS). Poți merge în secțiunea Explore și poți crea un segment care include doar sesiunile din acel oraș. Aplicându-l, vei vedea, cel mai probabil, că toate au o durată de 0 secunde și o rată de respingere de 100%. Asta îți confirmă bănuielile.

Pentru a curăța datele de acum încolo, e simplu să creezi un filtru:

- Mergi în Admin > Data Settings > Data Filters.

- Creează un filtru nou, de tip “Exclude”.

- Definește regula, de exemplu:

Traffic type=DevelopersauIP Address=[adresa IP suspectă].

Cel mai util este că poți combina condițiile. Poți crea un filtru care exclude traficul ce vine simultan de la un anumit ISP ȘI dintr-o anumită țară, asigurându-te că nu blochezi din greșeală utilizatori legitimi.

Testul suprem: potrivește datele cu vânzările reale

Analiza din Analytics este esențială, dar adevărul absolut stă în altă parte: în CRM-ul tău sau în platforma de e-commerce. Acolo vezi impactul real, în bani. Acesta este testul final pentru calitatea traficului.

Uite un exemplu concret. GA4 îți arată 100 de conversii (comenzi) dintr-o campanie Facebook Ads într-o săptămână. Când te uiți însă în Magento sau WooCommerce, găsești doar 60 de comenzi reale, plătite, din aceeași campanie. Ce s-a întâmplat cu diferența de 40?

Discrepanțele apar din mai multe motive posibile:

- Trafic fraudulos: Boți care dau clicuri și ajung pe pagina de mulțumire fără să plătească nimic.

- Probleme de tracking: Același client a fost înregistrat de mai multe ori sau evenimentul de conversie s-a declanșat eronat.

- Comenzi eșuate: Utilizatori care ajung pe pagina de confirmare, dar plata lor eșuează.

Reconcilierea acestor cifre este un exercițiu de igienă a datelor pe care trebuie să-l faci periodic. Te forțează să investighezi și să înțelegi unde se rupe legătura dintre click-uri și vânzări. Acolo, în diferența dintre conversiile raportate și banii intrați în cont, se ascunde de obicei traficul de slabă calitate. Acest proces te ajută să ajustezi campaniile și să bagi bani doar în ce aduce clienți reali, nu doar cifre frumoase în rapoarte.

Ai întrebări? Aici găsești răspunsurile

Când te apuci serios de verificarea traficului, e normal să apară tot felul de întrebări. Am adunat aici răspunsurile la cele mai comune dileme, ca să te ajute să mergi mai departe cu încredere și să nu te blochezi în detalii tehnice.

Să treci prin atâtea surse de date și să le pui cap la cap poate părea copleșitor la început. Dar odată ce prinzi logica, totul devine mai clar. Hai să vedem care sunt cele mai arzătoare curiozități.

De ce nu se potrivesc niciodată cifrele din GA4 cu celelalte unelte?

Ah, clasica problemă! Deschizi GA4, apoi te uiți în Search Console sau Cloudflare și… surpriză, datele nu seamănă deloc. E una dintre cele mai mari frustrări, dar are o explicație logică: fiecare unealtă măsoară lucruri complet diferite, cu metode total distincte.

Gândește-te așa: GA4 se bazează pe un cod JavaScript care se încarcă în browserul vizitatorului. Dacă cineva folosește un ad-blocker sau are JavaScript dezactivat (și se întâmplă!), vizita lui e complet invizibilă pentru Analytics. Asta înseamnă că traficul real poate fi subestimat cu 10-25%, uneori chiar mai mult, în funcție de publicul tău.

Pe de altă parte, uneltele care citesc direct de pe server, cum ar fi Cloudflare sau log-urile, înregistrează absolut orice cerere trimisă către site. Ele văd tot, fără filtru:

- Utilizatorii reali, cei care contează cu adevărat.

- Boții buni de la motoarele de căutare (cum e Googlebot), esențiali pentru indexare.

- Alți roboței de la unelte SEO (precum SemrushBot, AhrefsBot).

- Trafic de la scripturi automatizate sau chiar atacuri, pe care un firewall le-ar bloca.

Nu încerca să faci cifrele să se potrivească la virgulă – e o misiune imposibilă. Cheia e să înțelegi ce-ți spune fiecare unealtă în parte. Folosește-le complementar, ca pe niște piese dintr-un puzzle, pentru a obține imaginea de ansamblu.

Cât de des ar trebui să fac o analiză completă a traficului?

Nu există o regulă bătută în cuie, totul depinde de business-ul tău și de cât de agitată e piața în care activezi. Totuși, putem stabili câteva repere sănătoase.

Pentru o verificare de rutină, o dată pe săptămână e suficient. Aruncă un ochi peste rapoartele principale din GA4 și Search Console. Așa prinzi din zbor tendințele, vezi cum performează un articol nou sau depistezi rapid orice anomalie, cum ar fi o cădere bruscă de trafic organic care nu are nicio explicație logică.

În schimb, o analiză în profunzime, unde compari totul cu log-urile de server și datele din CDN, e bine s-o faci trimestrial. Acest audit devine însă obligatoriu în momente cheie:

- După ce ai lansat o campanie de marketing importantă.

- Imediat înainte și după un redesign sau o migrare de site.

- Când vezi că vânzările și traficul raportat parcă trăiesc în universuri paralele.

O monitorizare constantă, chiar și superficială, bate oricând un audit făcut rar și în grabă.

Traficul de la boți îmi poate afecta ranking-ul în Google?

Aici, răspunsul e “da și nu”. Impactul este mai degrabă indirect, dar categoric nu trebuie ignorat. Să facem o distincție clară între cele două tipuri de boți.

Pe de o parte, avem boții buni, cum ar fi Googlebot. Ei sunt vitali – îți scanează site-ul ca să-l poată indexa. Să-i blochezi ar fi o greșeală catastrofală. Activitatea lor e normală și chiar de dorit.

Pe de altă parte, sunt boții răi: cei de spam, de scraping, cei care caută vulnerabilități. Aceștia nu duc la o penalizare directă de la Google. Algoritmii sunt destul de deștepți încât să ignore, în mare parte, acest zgomot de fond când evaluează relevanța unui site.

Totuși, impactul negativ se simte în altă parte:

- Serverul gâfâie: Un val de cereri de la boți malițioși poate consuma resursele serverului, ceea ce duce la un site mai lent pentru vizitatorii reali. Iar viteza de încărcare este un factor de ranking confirmat.

- Datele devin o mizerie: Acesta e cel mai mare risc. Datele “poluate” te pot păcăli să iei decizii SEO proaste. De exemplu, poți ajunge să crezi că o pagină e super populară, când de fapt e vizitată doar de boți, și să investești timp și bani în optimizarea ei fără niciun rezultat.

Așadar, să filtrezi și să blochezi boții răi nu e doar o chestiune de securitate. E o practică esențială de igienă digitală, care te ajută să lucrezi cu date curate și să-ți bazezi strategia pe realitate, nu pe iluzii.

Pentru a te asigura că site-ul tău rulează pe o infrastructură rapidă și securizată, capabilă să gestioneze atât traficul real, cât și să filtreze activitatea nedorită, BTS Telecom SRL oferă soluții de hosting performante. Descoperă planurile noastre optimizate și beneficiază de suport tehnic 24/7 pe https://btstelecom.ro.